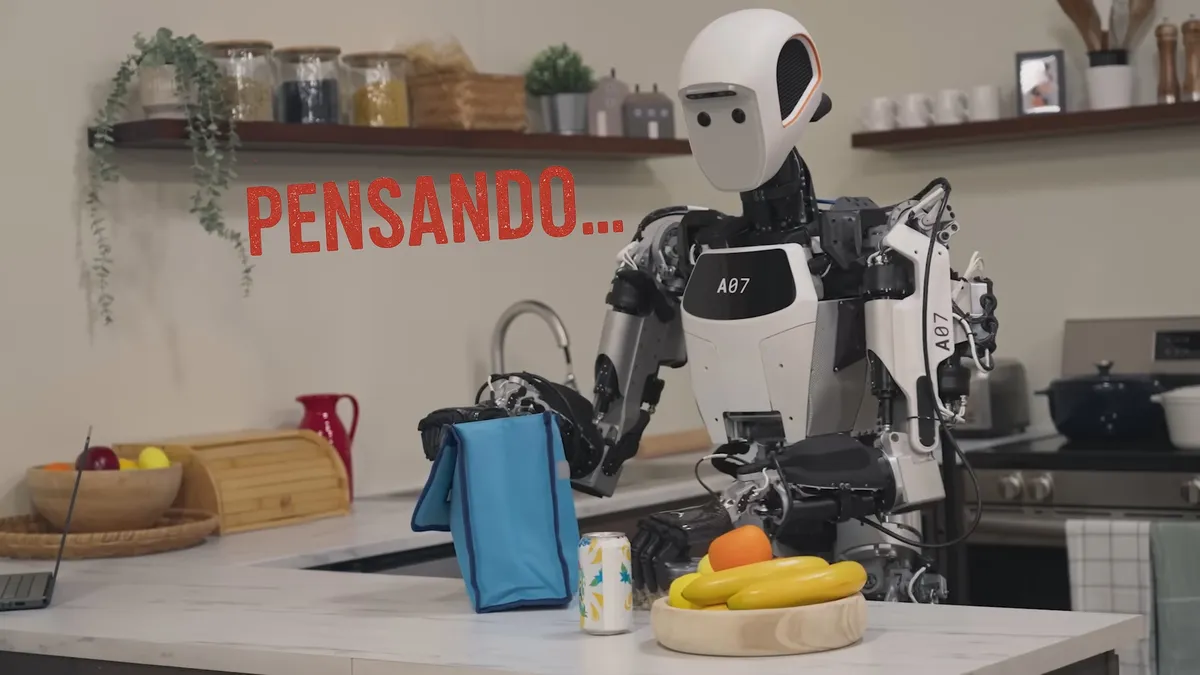

Já está aqui Gemini Robotics 1.5, a IA do Google para dar vida aos robôs: “Pensam antes de agir”

O Google acaba de lançar o Gemini Robotics 1.5, um novo modelo de IA focado em robôs humanoides que integra o raciocínio em sua IA generativa. Essa inovação é extremamente importante para que os robôs possam executar tarefas por conta própria, sem a necessidade de treinamento prévio.

Na verdade, o que o Google DeepMind criou foi o uso complementar de dois modelos de linguagem. O Gemini Robotics-ER 1.5 observa o ambiente, analisa e decide o que fazer, enquanto o Gemini Robotics 1.5 executa as ações. Agora, os robôs realmente “pensam antes de agir”.

Os robôs humanoides utilizam uma IA generativa convencional, o que representa uma grande limitação, pois precisam ser treinados previamente para realizar uma única tarefa, por menor que seja. Esse processo é caro e demorado, retardando sua evolução.

O Raciocínio Chega aos Robôs

O Gemini Robotics emprega duas inteligências artificiais para avançar no desenvolvimento dos robôs: uma “pensa” e a outra “age”, de maneira similar ao que um ser humano faria em condições normais. Embora existam aqueles que agem antes de pensar, essa abordagem representa um avanço tecnológico significativo.

O Gemini Robotics-ER 1.5 é, tecnicamente, um modelo de visão-linguagem (VLM) que recebe entradas visuais e textuais para gerar os passos necessários na execução de uma tarefa complexa. As siglas “ER” significam Raciocínio Incorporado.

Já o Gemini Robotics 1.5 é um modelo de visão-linguagem-ação (VLA), que utiliza dados visuais e textuais para gerar ações robóticas.

Quando o robô se depara com uma tarefa desconhecida para a qual não foi treinado por exemplo, separar a roupa da lavandaria por cores o Gemini Robotics-ER 1.5 entra em ação: ele visualiza o ambiente, identifica os itens e a tarefa e busca informações adicionais em sua base de dados ou na internet para compreender o que precisa ser feito.

Em seguida, o robô “pensa” a tarefa, ou seja, cria uma lista de etapas para completá-la. Por exemplo: “pegue a peça que está na parte superior, analise a cor e, se for tal cor, coloque-a em um grupo; se for outra, coloque em outro”.

Essa lista de etapas é enviada ao Gemini Robotics 1.5, que a transforma em ordens diretas para o robô: mover o braço em direção à roupa, abrir a mão para agarrar a peça que está mais alta, e assim por diante.

Essa tecnologia representa um avanço revolucionário para os robôs. Quando a tecnologia do Google funcionar em sua totalidade, não será mais necessário treinar o robô por dias ou semanas para concluir uma nova tarefa. Basta informá-lo do que deve ser feito, e o robô humanoide descobrirá como realizar a ação.

Embora não seja uma novidade utilizar modelos de IA para tarefas robóticas, essa é a primeira vez que modelos de raciocínio avançado são aplicados especificamente a essas funções.

Trata-se de um passo significativo rumo aos robôs que pensam por si mesmos e, consequentemente, em direção à Inteligência Artificial Geral (AGI).

Conteúdo por Computer Hoy.