Esta inovação do Google pode tornar o ChatGPT e outros modelos mais baratos

Os diversos modelos de linguagem de grande escala (LLM) transformaram a tecnologia, impulsionando aplicações de inteligência artificial, como o ChatGPT. No entanto, gerar respostas continua sendo um processo lento e bastante oneroso.

Agora, o Google Research apresentou uma solução que pode mudar esse cenário por meio de um novo método chamado cascadas especulativas.

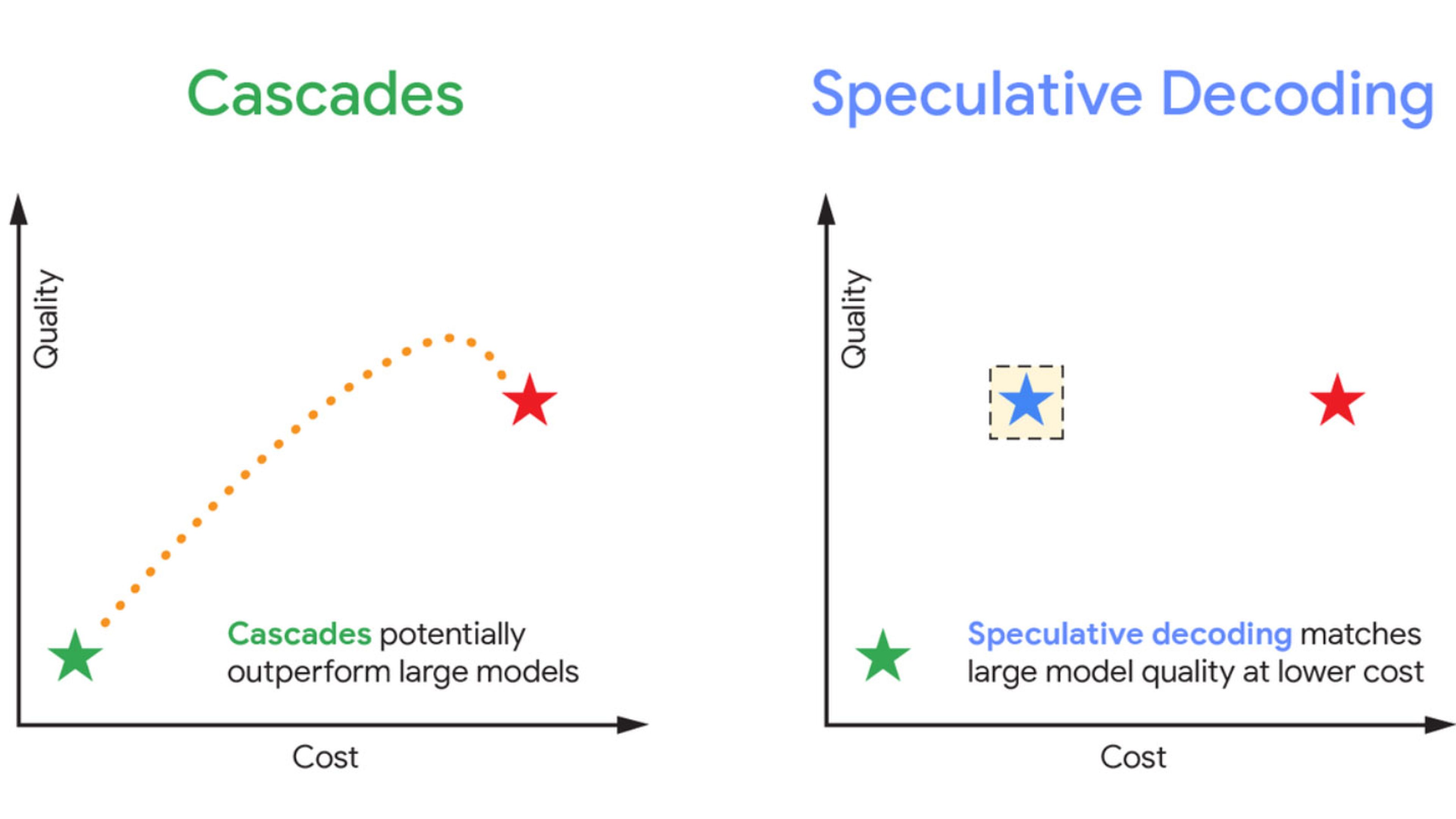

Até então, existiam duas abordagens principais para acelerar esses modelos. A primeira, as cascadas, utiliza modelos pequenos e rápidos antes de consultar um modelo maior e mais caro, mas pode se tornar lento se o modelo menor não estiver seguro de sua resposta.

O segundo método é a decodificação especulativa, que prevê tokens em paralelo com um modelo pequeno que, em seguida, é verificado pelo modelo maior.

A inovação do Google combina o melhor de ambos os métodos. Com as cascadas especulativas, um sistema pode aceitar respostas corretas de um modelo pequeno mesmo que estas não coincidam exatamente com a saída do modelo maior, evitando os gargalos sequenciais das cascadas tradicionais.

Para testar essa técnica, os pesquisadores a aplicaram em modelos como Gemma e T5, avaliando-os em tarefas de resumo, raciocínio e codificação.

Os resultados demonstraram melhorias concretas em velocidade e eficiência, proporcionando um melhor equilíbrio entre custo e qualidade.

Embora essa técnica ainda esteja em fase de pesquisa, se implementada, poderá oferecer aos usuários experiências mais rápidas e econômicas em aplicações baseadas em modelos de linguagem de grande escala.